495/68 (IT) ประจำวันศุกร์ที่ 28 พฤศจิกายน 2568

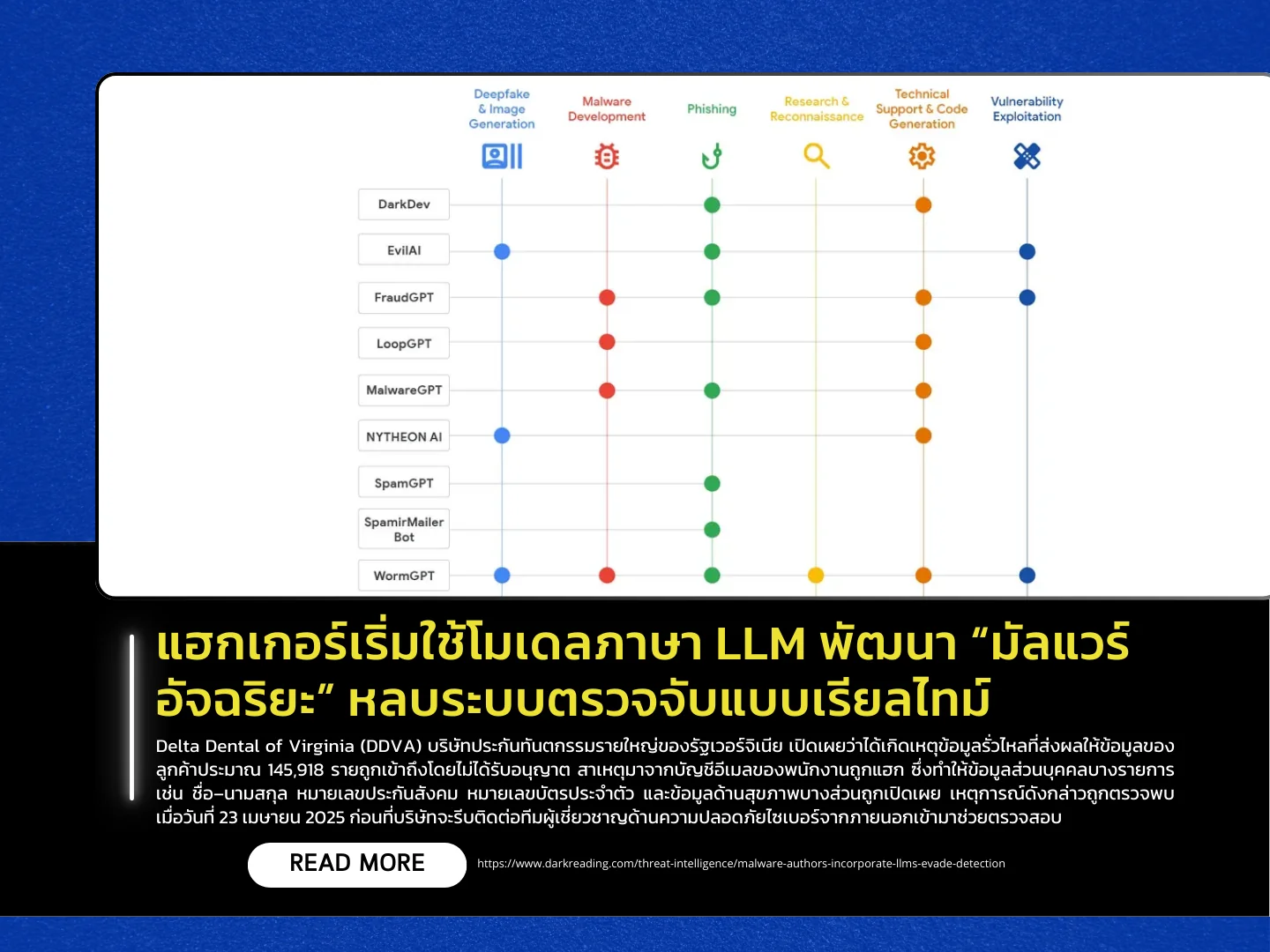

รายงานล่าสุดจาก Google Threat Intelligence Group (GTIG) เปิดเผยเทคนิคใหม่ของกลุ่มผู้ไม่หวังดีที่กำลังทดสอบการผสานโมเดลภาษาขนาดใหญ่ (LLMs) เช่น Google Gemini และ Hugging Face เข้าไปในตัวมัลแวร์โดยตรง เพื่อให้มัลแวร์สามารถเขียนโค้ดซ้ำ หรือสร้างคำสั่งโจมตีใหม่ได้ทันทีในขณะที่โปรแกรมกำลังทำงาน เป้าหมายหลักคือการปรับเปลี่ยนรูปแบบคำสั่งเพื่อหลบเลี่ยงการตรวจจับจากเครื่องมือความปลอดภัย และช่วยเพิ่มขีดความสามารถให้แฮกเกอร์ระดับเริ่มต้นสามารถปฏิบัติการด้วยเครื่องมือที่ซับซ้อนได้ง่ายขึ้น

ผู้เชี่ยวชาญระบุว่า LLM จะช่วยให้แฮกเกอร์ระดับสูงทำงานได้มีประสิทธิภาพมากยิ่งขึ้น และยังเปิดโอกาสให้ผู้โจมตีระดับเริ่มต้นพัฒนามัลแวร์ที่ซับซ้อนได้ โดยไม่ต้องมีทักษะเชิงลึกมากนัก แม้มัลแวร์หลายตัวในกลุ่มนี้ยังเป็นเพียงต้นแบบ แต่ก็มีบางส่วนที่ถูกใช้จริง เช่น FRUITSHELL ที่ฝังคำสั่งเพื่อหลบการตรวจจับไว้ในตัว หรือ QUIETVAULT ที่ใช้ AI ช่วยค้นหาและขโมยข้อมูลลับจากระบบเป้าหมาย นักวิเคราะห์ยังพบว่าแฮกเกอร์เริ่มใช้กลยุทธ์การหลอกระบบความปลอดภัยของ AI (Jailbreak) โดยอ้างว่าต้องการโค้ดไปใช้ในการฝึกซ้อมหรือแข่งขัน Capture the Flag (CTF) ส่งผลให้ AI ยอมปล่อยชุดคำสั่งอันตรายออกมา ซึ่งตามปกติจะต้องถูกบล็อก

ถึงแม้ว่าเทคนิคการใช้ LLM ในมัลแวร์ยังไม่แพร่หลายและมีข้อจำกัดจากการต้องเชื่อมต่อบริการภายนอก แต่ความสามารถในการดัดแปลงโค้ดแบบเรียลไทม์ทำให้แนวโน้มภัยคุกคามนี้อาจทวีความซับซ้อนในอนาคต ผู้เชี่ยวชาญด้านความปลอดภัยแนะนำให้องค์กรเสริมมาตรการควบคุมทราฟฟิกออกนอกระบบ (egress control) และติดตามการเรียกใช้บริการ AI ภายนอกอย่างเข้มงวด พร้อมใช้โมเดลตรวจจับพฤติกรรมที่อาศัย Machine Learning เพื่อวิเคราะห์พฤติกรรมที่ผิดปกติ (Behavioral Analysis) แทนการพึ่งพาการตรวจจับรูปแบบโค้ด (Signature-based) เพียงอย่างเดียว

แหล่งข่าว https://www.darkreading.com/threat-intelligence/malware-authors-incorporate-llms-evade-detection